Momentum

Momentum(관성)의 사전적 정의는 외부에서 힘을 받지 않는 한 정지해 있거나 운동 상태를 지속하려는 성질이다. 예를 들어, 경사진 곳에서 돌을 굴리면 계속해서 아래로 굴러가려는 성질이다.

이러한 성질을 활용하여 고안된 Momentum은 경사 하강법으로 이동할 때 관성을 부여하는 최적화 기법이다.

즉, Momentum은 이전에 이동했던 방향을 기억하면서 이전 기울기의 크기를 고려하여 어느 정도 추가로 이동시킨다.

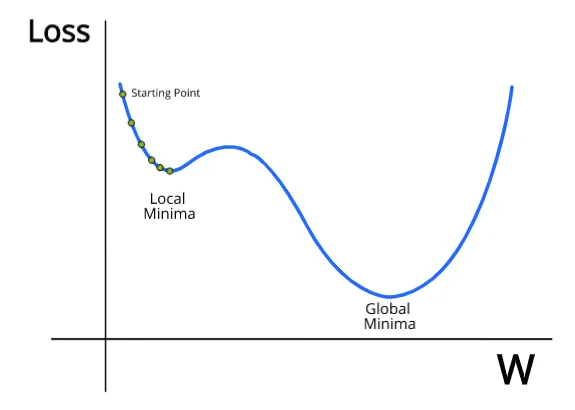

위의 그림과 같이 좌측에서부터 경사하강법으로 손실 함수를 줄여나가다가 Local Minimum에 빠질 수 있는 상황에서 Momentum 기법을 사용하면 이전 기울기의 크기를 고려해 추가로 이동하기 때문에 이를 빠져나갈 수 있다.

이후 그림의 Global Minimum이라고 표시한 지점에 도달했을 때는 추가적인 관성을 받아도 더 올라갈 수 없기 때문에 이 지점이 Global Minimum이 된다. 이처럼 Momentum은 Local Minimum에 빠지는 경우를 대처할 수 있다는 특징이 있다.

Momentum을 수식으로 나타내면 아래와 같다.

•

: 번째 time step에서 의 이동 벡터

•

: 관성계수(momentum term) 0.9

•

: 학습률(Learning rate)

번째 이동 벡터()는 이전 time step에서의 이동 벡터()과 관성 계수를 곱한 값에서 학습률()과 ()번째 의 Gradient 값을 빼서 구할 수 있다. 관성 계수는 1보다 작은 약 0.9로 일반적으로 설정한다.

여기서 학습률이란 어떤 비율만큼 파라미터를 업데이트할지를 결정하는 값으로 0과 1 사이의 값을 가지며, 사용자가 직접 설정해야 하는 하이퍼파라미터(hyper-parameter)이다.

즉, 학습률이 작을수록 촘촘하게 파라미터를 변화시키며 모델을 학습시킬 수 있지만 그만큼 학습 시 시간이 오래 걸린다. 반면, 학습률이 너무 클 경우 손실 함수 그래프 자체를 벗어나는 경우가 생길 수 있기 때문에 적절한 학습률을 선택하는 것이 중요하다.

즉, 번째 값은 ()번째 값에서 번째 이동 벡터를 더한 값으로 계산할 수 있다.

이처럼 Momentum은 이동 벡터를 활용하여 이전 step에서의 기울기를 고려한 알고리즘이다.

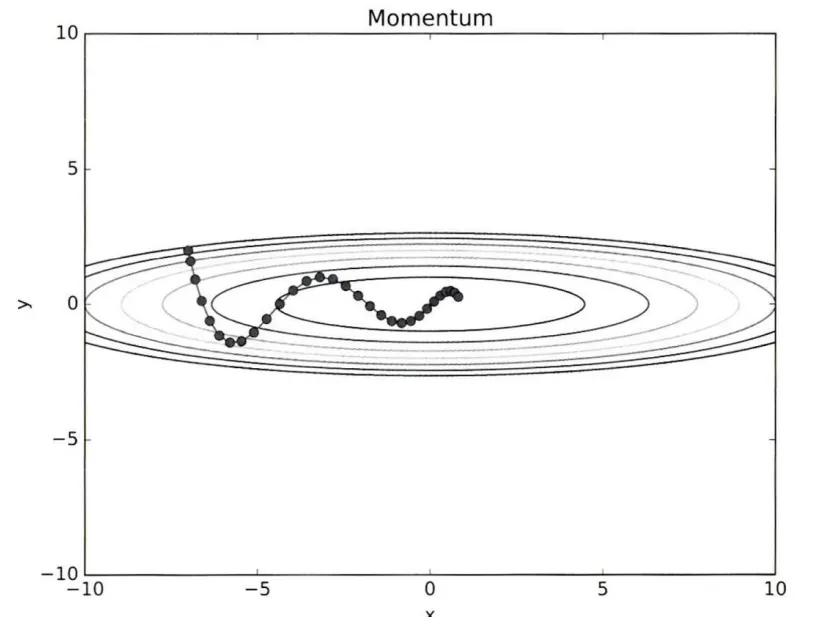

→ Momentum에 의한 최적화 갱신 경로

AdaGrad

AdaGrad는 Adaptive Gradient의 약자이고, 적응적 기울기라고 부른다.

Feature마다 중요도, 크기 등이 제각각이기 때문에 모든 Feature마다 동일한 학습률을 적용하는 것은 비효율적이었고, 이러한 관점에서 AdaGrad 기법이 제안되었다. AdaGrad는 Feature별로 학습률(Learning rate)을 Adaptive하게, 즉 다르게 조절하는 것이 특징이다.

AdaGrad를 수식으로 나타내면 아래와 같다.

: 번째 time step 까지의 기울기 누적 크기

: 분모가 0이 되는 것을 방지하기 위한 작은 값

: 학습률(Learning rate)

먼저 번째 time step까지 기울기를 누적한 값(을 계산한다. 이 값의 제곱근 역수를 번째 time step에서의 의 학습률에 곱한다. 이때 가 0인 경우 값이 무한대로 발산할 수 있기 때문에, 이를 방지하기 위해 매우 작은 값()을 같이 더해준다.

•

장점

AdaGrad는 Feature 마다 다른 학습률을 적용함으로써 Feature별 특성을 고려하여 학습을 효율적으로 돕는다는 장점이 있다. 즉, AdaGrad는 큰 기울기를 가져 학습이 많이 된 변수는 학습률을 감소시킨다. 학습이 적게 된 다른 변수는 잘 학습되도록 학습률을 높게 설정하여 조절할 수 있다는 장점이 있다.

•

단점

값은 점차 커지기 때문에 학습이 오래 진행되면 학습률()이 0에 가까워지기 때문에 더 이상 학습이 진행되지 않을 수 있다. 즉, 모델 학습이 진행될 때 학습이 잘 이루어져 더 이상 변수의 값이 업데이트되지 않는 것인지, 의 값이 지나치게 커져서 추가적으로 학습이 되지 않는 것인지 알기 어렵다는 한계가 있다. 이러한 한계점을 개선한 최적화 기법으로 RMSProp이 제안되었다.

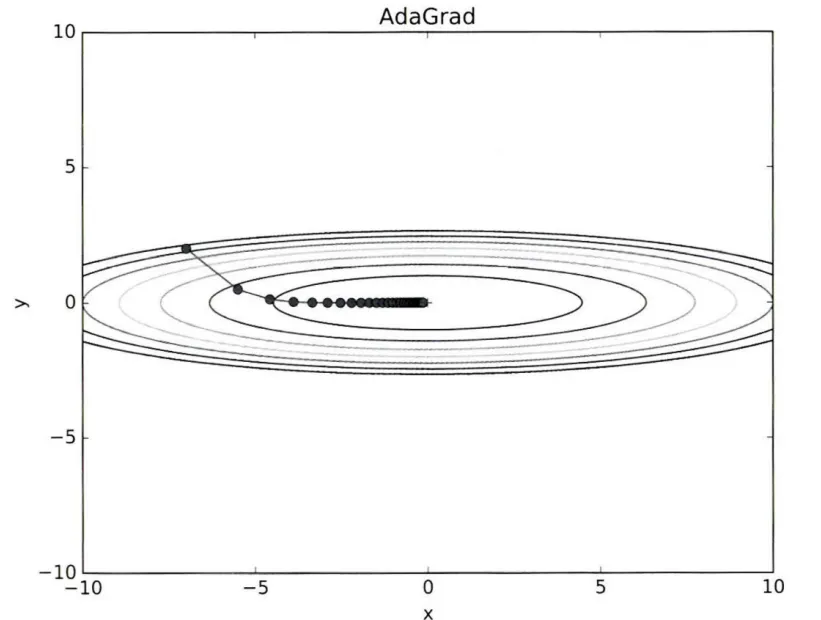

→ AdaGrad에 의한 최적화 갱신 경로

RMSProp

RMSProp은 Root Mean Sqaure Propagation의 약자이다.

AdaGrad는 학습이 진행될 때 학습률(Learning rate)이 꾸준히 감소하다 나중에는 0으로 수렴하여 학습이 더 이상 진행되지 않는다는 한계가 있다. RMSProp은 이러한 한계점을 보완한 최적화 기법이다.

RMSProp은 AdaGrad와 마찬가지로 변수(feature)별로 학습률을 조절하되 기울기 업데이트 방식에서 차이가 있다. 이전 time step에서의 기울기를 단순히 같은 비율로 누적하지 않고 지수이동평균(Exponential Moving Average, EMA)을 활용하여 기울기를 업데이트한다. 즉, 알고리즘의 핵심은 가장 최근 time step에서의 기울기는 많이 반영하고 먼 과거의 time step에서의 기울기는 조금만 반영하는 점이다.

RMSProp을 수식으로 나타내면 아래와 같다.

: 번째 time step 까지의 기울기 누적 크기

: 지수이동평균의 업데이트 계수

: 분모가 0이 되는 것을 방지하기 위한 작은 값

: 학습률(Learning rate)

번째 time step의 누적 기울기(는 이전 time step까지의 누적 기울기()에 를 곱해 점차 작게 만들어 주고, 새로운 Gradient에는 ()를 곱한 값을 더하여 업데이트 한다. 이 값의 제곱근 역수를 번재 time step에서의 의 학습률에 곱한다. 이때 가 0인 경우 값이 무한대로 발산할 수 있기 때문에, 이를 방지하기 위해 매우 작은 값()을 같이 더해준다.

•

장점

변수(feature)마다 적절한 학습률을 적용하여 효율적인 학습을 진행할 수 있다.

AdaGrad보다 학습을 오래 할 수 있다.

AdaGrad에서는 를 계산할 때 와 새로운 Gradient의 값을 보정하지 않고 그대로 더하였기 때문에 학습이 진행될수록 무한정 커지는 경우가 발생했다. 반면, RMSProp은 를 활용하여 가 무한정 커지는 것을 방지하기 때문에 오래 학습할 수 있다.

Adam

Adaptive Moment Estimation(Adam)은 딥러닝 최적화 기법 중 하나로써 Momentum과 AdaGrad의 장점을 결합한 알고리즘이다. 즉, 학습의 방향과 크기(=Learning rate)를 모두 개선한 기법으로 딥러닝에서 가장 많이 사용되는 최적화 기법으로 알려져 있다. 최근에는 RAdam, AdamW과 같이 더욱 우수한 성능을 보이는 최적화 기법이 제안되었다.

Adam을 수식으로 나타내면 아래와 같다.

•

: Momentum의 지수이동평균

•

: RMSProp의 지수이동평균

•

, : 학습 초기 시 , 가 0이 되는 것을 방지하기 위한 보정 값

•

: 분모가 0이 되는 것을 방지하기 위한 작은 값

•

: 학습률

지수이동평균

는 지수이동평균(Exponential Moving Average, EMA)으로써 하이퍼파라미터이다.

지수이동평균은 오래전 time step에서의 값은 적게 반영하고 최근 step의 값을 많이 반영하기 위한 값이다.

편향 보정

은 학습 초기에 의 값에서 가 0이고, 과

이 너무 작기 때문에 0에 수렴하는 것을 방지하기 위한 보정값이다. 수식에서 볼 수 있듯이, Gradient에 곱해진 와를 없앨 수 있도록 을 해당 값으로 나눈 값이다.

이처럼 의 초기값이 0에 가까워지는 편향(bias)의 문제를 해결하기 위해 을 만드는 과정을 편향 보정(bias correction)이라고 한다. 학습이 계속 진행되다 보면 와는 거의 1에 가까워지기 때문에, 는 결국 와 같은 값이 된다.

학습률

학습률()이란 어떤 비율만큼 파라미터를 업데이트할지를 결정하는 값으로 0과 1사이의 값으로써 하이퍼파라미터이다. 연구결과에 따르면, Adam 알고리즘에서 학습률은 0.001이 가장 좋은 설정 값이라고 알려져 있다.

→ Adam에 의한 최적화 갱신 경로

.png&blockId=bb030b8b-f247-494c-8a2e-a0673390180d)